Highlights

La tentación del ahorro

Para estudios pequeños, la IA promete iteración rápida y reducción de costos. En un país con financiamiento escaso, esa promesa es difícil de ignorar. Pero ignorar los riesgos puede salir caro.

El fantasma del copyright

Ali Mirsaidi, socio de Perkins Coie, advierte sobre disputas legales y falta de regulación clara. Muchas herramientas fueron entrenadas con trabajo de artistas sin consentimiento, y la comunidad reacciona rápido cuando lo percibe.

La lupa sobre Paraguay

En una escena chica pero ambiciosa, cada error se amplifica. Adoptar IA sin entender sus implicancias puede poner en riesgo no solo a un estudio, sino a la reputación de todo un ecosistema en construcción.

En el 2025, uno de cada cinco juegos lanzados en Steam declaraba uso de IA generativa, y la tendencia no hace más que acelerarse. Para estudios grandes, la ecuación es simple: herramientas que prometen iteración más rápida, mayor volumen de contenido y potencial ahorro de costos son difíciles de ignorar cuando producir un triple A se ha vuelto exponencialmente más caro y lento.

Pero como señala Ali Mirsaidi, socio del estudio legal Perkins Coie y especialista en entretenimiento digital, en un análisis publicado por GamesIndustry, la adopción de inteligencia artificial no es neutral en términos de riesgo. Entre disputas de copyright, falta de regulación clara y una comunidad que reacciona rápido cuando percibe que las herramientas fueron entrenadas con trabajo de artistas sin consentimiento, el camino está lleno de señales de alerta que muchos estudios —especialmente los pequeños— tienden a subestimar.

Y acá, en Paraguay, donde la escena de desarrollo es chica pero ambiciosa, esas señales deberían encenderse con más fuerza que en cualquier otro lado.

La visibilidad del riesgo: no todo el uso de IA es igual

Uno de los puntos centrales del análisis de Mirsaidi es que el riesgo legal y reputacional del uso de la Inteligencia Artificial varía drásticamente según en qué etapa del desarrollo se aplique. No es lo mismo usar herramientas generativas para backend y código —un uso interno, poco visible y ya aceptado en toda la industria tecnológica— que para generar activos finales que llegarán al jugador.

En el medio están usos intermedios: arte conceptual, ideación temprana, exploración visual. Como son procesos internos y descartables, el riesgo es manejable. Pero cuando se usa para generar modelos de personajes, texturas, animaciones o voces y diálogos que terminan en el producto final, la exposición crece exponencialmente.

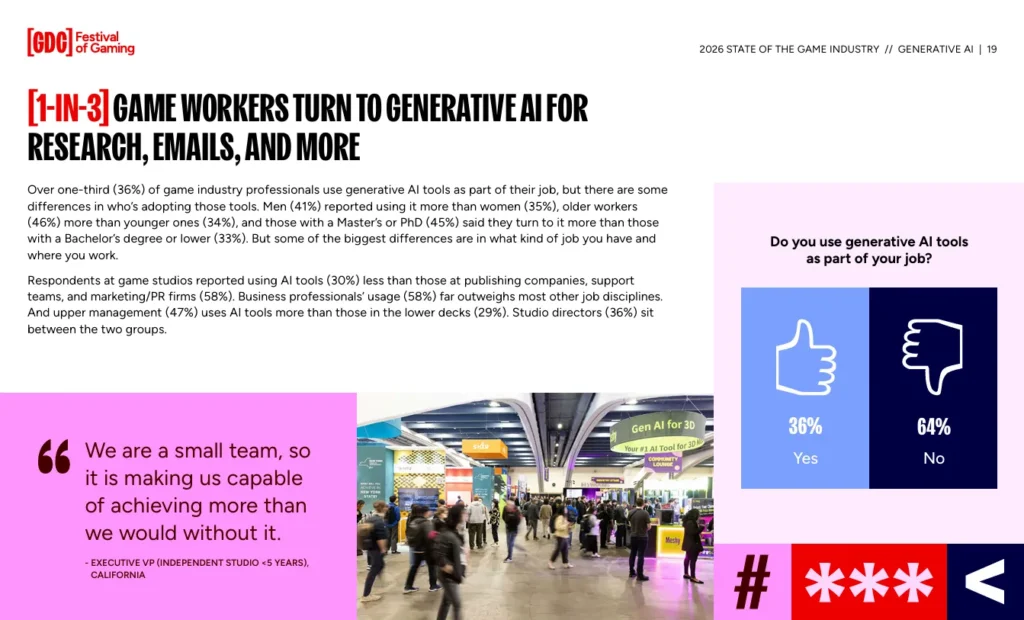

Recordemos justamente, en este punto, la edición 2026 del State of the Game Industry, el informe anual de GDC basado en encuestas a más de 2.300 profesionales del sector, donde el 36% de los trabajadores afirmó utilizar herramientas de IA generativa como parte de su trabajo.

Para un estudio paraguayo que está pensando en incorporar Inteligencia artificial a su pipeline, esta distinción es clave. Porque si bien las herramientas de terceros son accesibles y tentadoras, también implican ceder control sobre aspectos fundamentales: ¿con qué datos fue entrenado ese modelo? ¿Qué medidas de seguridad existen para evitar que reproduzca material protegido, dañino o ilegal? Cuanto más lejos esté el estudio del modelo que usa, menos visibilidad tiene sobre su contenido.

Y la responsabilidad, legal y reputacional, no se queda en el proveedor de la herramienta. Si un activo generado por IA infringe derechos de autor y termina en un juego publicado, el estudio que lo publicó y monetizó puede ser considerado responsable. Hasta ahora los litigios se han concentrado en los proveedores de IA, pero eso puede cambiar rápidamente a medida que el uso se masifique.

El copyright: lo viejo y lo nuevo

La discusión sobre copyright y entrenamiento de modelos de IA está lejos de resolverse. Los tribunales federales de Estados Unidos ya emitieron fallos contradictorios sobre si entrenar modelos con obras protegidas puede considerarse “uso justo”. Y aunque los jueces eventualmente se pongan de acuerdo, eso no significa que la comunidad vaya a aceptarlo.

Para estudios pequeños, esto plantea un dilema: incluso si el uso de IA es legal, puede ser percibido como ilegítimo por una parte de la audiencia. Y en una escena como la paraguaya, donde la construcción de comunidad y confianza es todavía artesanal, un escándalo de ese tipo puede ser terminal.

Además, está la cuestión de la protección de las propias creaciones. La Oficina de Derechos de Autor de Estados Unidos confirmó que las obras generadas íntegramente por sistemas automatizados no son elegibles para protección. Para una industria que vive de controlar propiedad intelectual valiosa, eso es un problema. La buena noticia es que cuando los creadores humanos pueden demostrar control significativo —selección, revisión, decisiones creativas deliberadas— alguna forma limitada de protección puede persistir, incluso si se usó IA.

Para un estudio paraguayo que sueña con construir una franquicia propia, entender ese matiz es crucial. Usar IA no es automáticamente renunciar a derechos, pero sí exige documentar el proceso creativo humano con mucho más cuidado que antes.

Lo que viene: regulación, reputación y el factor comunidad

Mirsaidi advierte que los temas más complejos de regular pueden estar todavía por venir. Uno de ellos es la intersección entre IA y derechos de imagen. A medida que las herramientas generativas facilitan replicar voces o apariencias reconocibles, los estudios van a enfrentar preguntas difíciles sobre si obtuvieron los consentimientos adecuados.

Otro es el comportamiento no guionizado en entornos con IA. Si los personajes generativos pueden decir o hacer cualquier cosa, los reguladores pueden empezar a preguntarse quién es responsable cuando cruzan la línea. Y un tercero, particularmente sensible en juegos como servicio, es el uso de IA para personalizar mecánicas de monetización y retención en tiempo real. Si las autoridades ya miran con lupa las cajas de botín y las microtransacciones, imagínense cuando la IA pueda ajustar ofertas individualmente para maximizar gasto.

Pero el riesgo más inmediato, dice Mirsaidi, no es regulatorio sino reputacional. Una mala noticia, un viral en redes sociales, puede hacer más daño que cualquier demanda. Y la comunidad de jugadores valora la creatividad humana. No es una cuestión de legalidad, es de percepción.

Eso se está formalizando cada vez más en lo que el autor llama “regulación blanda”: plataformas que exigen declarar uso de IA, premios que desarrollan estándares, acuerdos laborales que incorporan cláusulas específicas. Los estudios ahora tienen que seguir no solo la ley, sino también las políticas de plataformas y las expectativas de la comunidad.

Qué significa todo esto para Paraguay

La escena local de desarrollo de videojuegos ha dado pasos enormes en los últimos años. Hay momentum, hay visibilidad, hay ganas de más.

Pero también hay fragilidad. La mayoría de los proyectos locales operan con equipos chicos, márgenes ajustados y sin departamentos legales internos. En ese contexto, incorporar IA generativa sin entender los riesgos puede ser como poner un motor de F1 a un auto de calle: emocionante hasta que algo explota.

Para un estudio paraguayo, la tentación de usar herramientas de IA para acelerar producción es comprensible. Los deadlines existen, los presupuestos son reales, y la competencia no espera. Pero antes de subirse al tren, vale la pena hacerse algunas preguntas:

¿Entendemos qué datos entrenaron la herramienta que estamos usando? ¿Podemos verificar que no reproducirá material protegido? ¿Estamos usando IA para etapas internas o para activos finales? Si es para activos finales, ¿estamos haciendo las verificaciones necesarias? ¿Documentamos nuestro proceso creativo humano para poder reclamar derechos después? ¿Pensamos en cómo reaccionaría nuestra comunidad si supiera que usamos IA?

Son preguntas incómodas, y en un estudio o un grupo de devs pequeño pueden sentirse como lujo de ricos. Pero no lo son. Son preguntas de supervivencia a largo plazo.

El camino posible

Ningún estudio paraguayo va a resolver los problemas globales del copyright y la inteligencia artificial. Pero todos pueden tomar decisiones informadas. Pueden elegir herramientas con políticas claras. Pueden limitar el uso a etapas tempranas y no críticas. Pueden documentar su trabajo. Pueden ser transparentes con su comunidad sobre qué usan y por qué.

En una escena donde la confianza se construye de a poco y los vínculos son estrechos, la transparencia puede ser una ventaja competitiva, no una debilidad. Los jugadores locales valoran el esfuerzo, la identidad, el “hecho acá”. Si un estudio puede explicar por qué usa IA y cómo mantiene el control creativo humano, probablemente encuentre más comprensión que rechazo.

Lo que no puede hacer es ignorar el tema. Porque la inteligencia artificial no va a esperar a que los tribunales se pongan de acuerdo. Ya está acá, ya se usa, y los riesgos —legales y reputacionales— ya existen. La única pregunta es si los estudios paraguayos van a enfrentarlos con los ojos abiertos o a ciegas.

Hasta ahora, la escena local ha demostrado que sabe adaptarse, aprender y crecer. Este desafío no es distinto. Solo que esta vez, el manual de instrucciones todavía se está escribiendo. Y los que presten atención, van a llegar mejor preparados al próximo nivel.