Highlights

La pregunta que falta en el centro del debate

Mientras se discute si la IA generativa escribe mejor o peor que un humano, y si los escritores serán reemplazados, queda sin responder quién tiene los derechos sobre una historia co-creada en tiempo real entre jugador y sistema generativo.

Más allá de la ética del entrenamiento

La entrevista aborda el uso ético de datos y la pérdida de empleos, pero el verdadero desafío está en repensar la autoría cuando el jugador se convierte en parte activa del proceso narrativo.

Una pregunta que redefine el diseño

¿De quién es el relato que emerge de cada partida? La respuesta cambiaría no solo las licencias y los derechos, sino también la manera en que diseñamos sistemas narrativos para poner al jugador en el centro sin borrar la autoría.

La entrevista cruzada entre Daniel Griliopoulos y Thomas Keane que publicó GamesIndustry.biz es de esas conversaciones que merecen ser leídas con atención, crítica y llevando más allá el análisis. Porque toca todos los puntos sensibles del debate sobre inteligencia artificial en narrativa: la ética de los datos de entrenamiento, la calidad del contenido generado, la pérdida de empleos, el rol del escritor en un ecosistema que parece querer prescindir de él.

Pero hay un eje que la entrevista roza sin entrar en lo profundo, y que quizás sea el más complicado de argumentar, de todos: cuando el jugador interactúa con un sistema de IA generativa —haciendo preguntas, tomando decisiones, empujando la narrativa en direcciones no previstas— ¿de quién es el texto que emerge? ¿Quién tiene derechos sobre esa historia co-creada en tiempo real?

Griliopoulos y Keane discuten sobre si la IA puede escribir mejor o peor que un humano. Sobre si los modelos deberían ser entrenados con datos éticos. Sobre si los escritores serán reemplazados o, como sugiere Keane, vivirán una “era dorada” donde su trabajo se vuelve más valioso que nunca. Pero la pregunta sobre la propiedad de la narrativa generada en tiempo real —y sobre lo que esa pregunta implica para el futuro del diseño, la autoría y los derechos de los jugadores— queda en un segundo plano.

Y merece estar en el centro.

El jugador como coautor no reconocido

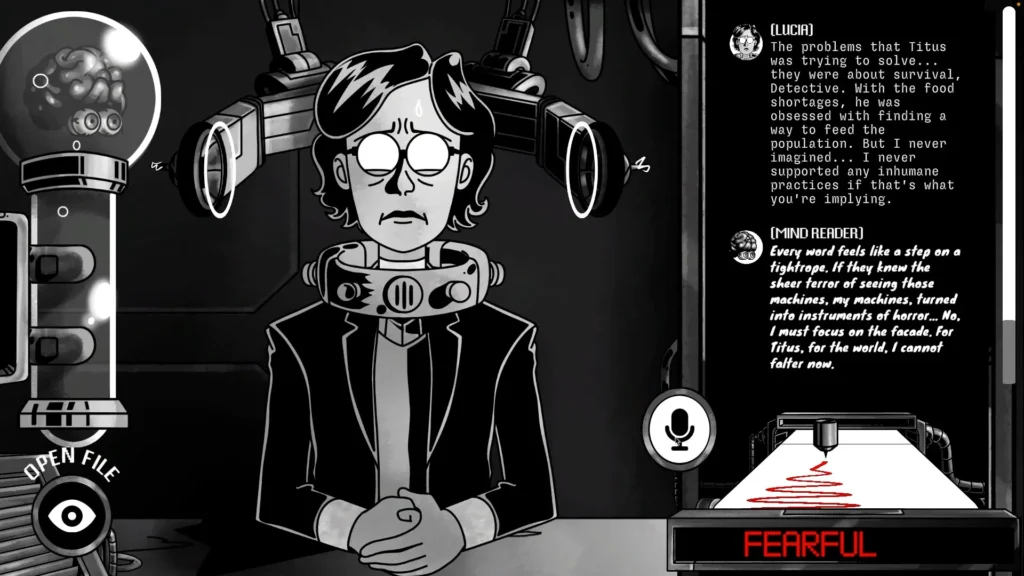

Keane describe su juego Dead Meat como una experiencia donde el jugador interroga a un sospechoso de asesinato usando lenguaje natural. No hay opciones de diálogo preescritas. El jugador escribe lo que quiere preguntar, y el sistema —alimentado por una combinación de contenido escrito por humanos y modelos de lenguaje— responde en consecuencia.

En términos de diseño, es fascinante. En términos de autoría, es un terreno movedizo.

¿Quién escribe ese interrogatorio? En parte, los escritores que crearon la “hiperespecificidad” que Keane menciona: esos fragmentos de memoria, esos detalles emocionales que dan profundidad al personaje. En parte, el modelo de IA, que adapta esas piezas al input del jugador. Pero también, y esto es clave, el jugador mismo, que con cada pregunta está co-creando la escena.

Si el jugador pregunta sobre la madre del sospechoso, y el sistema responde con una historia conmovedora sobre un trauma infantil, esa historia no existía antes de que el jugador la invocara. Es, en sentido literal, un texto generado en respuesta a un estímulo único. ¿A quién pertenece?

En los juegos tradicionales, la respuesta es simple: los diálogos fueron escritos por el equipo de desarrollo, las ramificaciones fueron diseñadas por los narrative designers, y el jugador las descubre pero no las crea. En un sistema como el de Meaning Machine, la línea se desdibuja. Y la ley, como siempre, llega tarde a estas conversaciones.

La trampa de la “libertad creativa”

Keane defiende el valor de su sistema argumentando que ofrece “libertad creativa” y “expresión personal” al jugador. Y tiene razón en un sentido superficial: poder escribir cualquier pregunta y recibir una respuesta coherente es una forma de libertad que los juegos con diálogos ramificados no pueden igualar.

Pero esa libertad tiene un costo que no se discute en la entrevista. El jugador está, sin saberlo, contribuyendo a un proceso creativo cuyo producto final —la escena específica, la confesión inesperada, el giro emocional— no puede ser reclamado como propio. No hay “escrito por” en el crédito final para quien escribió la pregunta que desencadenó el mejor momento del juego. No hay regalías por la frase que hizo llorar a otros jugadores en un stream.

La industria del videojuego lleva décadas lidiando con la tensión entre autoría y agencia. Los juegos narrativos tradicionales resuelven el problema con ilusiones: el jugador siente que eligió, pero todas las opciones fueron previstas. Los sistemas de IA generativa prometen resolver la ilusión con auténtica agencia, pero a costa de una nueva opacidad: ahora el jugador crea sin saber que está creando, y sin poder reclamar nada de lo que ayuda a producir.

Griliopoulos lo dice en otro tramo de la entrevista, refiriéndose a su propio oficio: “No quiero que Midjourney me haga una obra de arte, quiero pintar el cuadro”. Pero ¿qué pasa cuando el jugador quiere pintar el cuadro y el pincel le pertenece a una empresa que no le va a reconocer la autoría?

El precedente de otras industrias

No es la primera vez que la tecnología se adelanta a la ley en materia de autoría. En la música, los samples generaron décadas de litigios. En la fotografía, las cámaras digitales y después los smartphones cambiaron para siempre qué significa “tomar una foto”. En la literatura, la IA generativa ya está provocando debates sobre si un texto producido con asistencia de IA puede ser registrado con derechos de autor.

En todos los casos, la respuesta legal ha sido lenta, parcial y muchas veces injusta para los creadores individuales.

En los videojuegos, la conversación es aún más incipiente porque la tecnología de IA en narrativa está en sus primeras etapas. Pero si los sistemas como el de Meaning Machine se popularizan —y es probable que lo hagan, porque ofrecen algo que los jugadores valoran—, la pregunta sobre la autoría del input se volverá inevitable.

¿El jugador que escribe una pregunta particularmente brillante tiene algún derecho sobre la respuesta que genera? ¿La compañía que opera el modelo puede usar las conversaciones generadas para entrenar futuras versiones sin consentimiento explícito? ¿Los escritores humanos cuyo trabajo alimenta el sistema tienen derecho a saber qué preguntas desencadenaron sus fragmentos?

Ninguna de estas preguntas tiene respuesta fácil. Pero la entrevista entre Griliopoulos y Keane, tan rica en otros aspectos, apenas las roza.

El aprendizaje de los nuevos talentos y el monopolio de las herramientas

Otro eje que queda en segundo plano es el impacto en la formación de nuevos creadores. Griliopoulos menciona de pasada que los escritores “aman escribir”. No quieren curar una máquina, quieren hacer el producto final ellos mismos. Pero si las herramientas de IA generativa se convierten en el estándar para ciertos tipos de narrativa —diálogos de NPC, misiones secundarias, contenido procedural— ¿qué significa eso para alguien que está aprendiendo el oficio?

La entrevista no profundiza en esto, pero la pregunta es urgente. Si los sistemas de IA reemplazan la escritura de bajo nivel —los “barks” que Griliopoulos dice disfrutar— ¿dónde van a aprender los nuevos escritores el oficio? ¿Cómo se desarrolla el oído para el diálogo cuando los primeros borradores los hace una máquina? ¿Quién enseña a los narrative designers del futuro si los trabajos de entrada desaparecen?

Hay una tensión no resuelta entre lo que Keane llama “la era del escritor” —donde la calidad del contenido humano se vuelve más valiosa— y la realidad de que esa era puede estar reservada para unos pocos, mientras la mayoría queda relegada a curar el output de modelos que no entienden.

Y detrás de todo, el elefante más grande: las herramientas de IA no son neutrales. Quien controla los modelos, controla también los medios de producción narrativa. Si solo unas pocas empresas tienen acceso a los modelos más potentes, la “democratización” que algunos celebran puede convertirse en su opuesto: un monopolio tecnológico que dicta los términos de qué narrativas son posibles y quiénes pueden crearlas.

El camino que nadie eligió

Griliopoulos y Keane coinciden en algo fundamental: la IA no va a desaparecer. Los que se nieguen a participar, dice Keane, “abdican la responsabilidad” y dejan que “las peores personas del mundo” tomen las decisiones. Es un argumento poderoso, y probablemente cierto.

Pero participar no es lo mismo que aceptar sin preguntar. Y las preguntas sobre la propiedad del input del jugador, sobre los derechos de los escritores cuyos datos alimentan los modelos, sobre la formación de los nuevos talentos y sobre la concentración del poder tecnológico, no son preguntas secundarias. Son el centro del debate, aunque la entrevista no las trate como tal.

Mientras tanto, los sistemas avanzan. Los jugadores experimentan nuevas formas de libertad. Los escritores buscan su lugar en el nuevo ecosistema. Y las leyes, como siempre, corren atrás.

La conversación entre Griliopoulos y Keane es valiosa porque muestra a dos profesionales pensando en serio sobre el futuro. Pero la conversación que falta —sobre quién es dueño de lo que creamos cuando creamos juntos— es la que realmente definirá cómo se juega, se escribe y se vive esta tecnología.

Porque al final, la pregunta no es si la IA puede escribir mejor que un humano. La pregunta es si, en el proceso, nos olvidamos de preguntar a quién le pertenece la historia que entre todos contamos.